Wichtigste Erkenntnisse

- Interoperabilität ist wichtig, weil sie die Modellabsicht stabil hält, wenn die Arbeit über Toolchains hinweg verlagert wird.

- Durch Datenabgleich und disziplinierten Systemaustausch bleiben Parameter, Einheiten und Ergebnisse teamübergreifend reproduzierbar.

- Klarheit im Arbeitsablauf durch Verantwortlichkeiten, Versionsverwaltung und Schnittstellenprüfungen reduziert Nacharbeiten und Fehler in späten Phasen.

Die Modellierung physikalischer Systeme scheitert, wenn sich Modellzweck, Daten und Schnittstellen ändern, während die Arbeit zwischen verschiedenen Tools und Gruppen wechselt. Interoperabilität ist wichtig, da sie die Bedeutung Ihres Modells während der Bearbeitung, des Austauschs und der Überprüfung stabil hält, sodass die Ergebnisse nachvollziehbar bleiben und technische Entscheidungen vertretbar bleiben. Eine Kostenanalyse der Interoperabilitätslücken schätzt die vermeidbaren Kosten für die US-amerikanische Kapitalanlagenbranche auf etwa 15,8 Milliarden US-Dollar pro Jahr.

Teams betrachten Interoperabilität oft als Dateikonvertierung, aber das größere Risiko ist die semantische Abweichung. Parameter werden neu interpretiert, Einheiten werden angenommen, Signale werden umbenannt, und „das gleiche“ Subsystem verhält sich plötzlich wie ein anderes. Starke Interoperabilitätspraktiken sorgen dafür, dass Modelle über Toolchains hinweg und im Laufe der Zeit verständlich bleiben, sodass es bei der Inbetriebnahme, der Laborvalidierung und den Designprüfungen zu weniger Überraschungen kommt.

„Interoperabilität macht ein Modell zu einem Vermögenswert, auf den sich Ihr gesamtes Team verlassen kann.“

Interoperabilität in der physikalischen Systemmodellierung bedeutet konsistente Modellabsicht.

Interoperabilität bedeutet, dass das von Ihnen übergebene Modell dieselbe Absicht beibehält, wenn es von jemand anderem ausgeführt wird. Die Absicht umfasst den physikalischen Umfang, den Betriebspunkt, die erforderliche Genauigkeit und die angegebenen Annahmen. Wenn die Absicht konsistent ist, bleibt ein Modell über Toolchains hinweg interpretierbar und die Ergebnisse bleiben über Studien hinweg vergleichbar.

Beginnen Sie mit einem expliziten Modellvertrag, der beim Modell verbleibt und nicht nur in jemandes Kopf existiert. Dieser Vertrag legt fest, was das Modell darstellt, was es auslässt und wie „korrekt“ in Bezug auf Ergebnisse und Grenzen aussieht. Er definiert auch Zeichenkonventionen, Referenzrichtungen und Anfangsbedingungen, damit nachgelagerte Benutzer die Bedeutung nicht stillschweigend umkehren. Die Modellabsicht erfordert auch eine klare Grenze zwischen Physik und Steuerung, damit die Schnittstellensignale stabil bleiben.

Eine klare Zielsetzung reduziert Debatten, die Zeit in Überprüfungen verschwenden, da die Prüfer den Zweck und die Annahmen überprüfen können, bevor sie über Wellenformen diskutieren. Außerdem verhindert sie, dass gut gemeinte Bearbeitungen ein Studienmodell unter demselben Dateinamen in ein anderes Studienmodell verwandeln. Wenn die Zielsetzung des Modells stabil ist, wird die verbleibende Interoperabilitätsarbeit eher mechanisch als interpretativ.

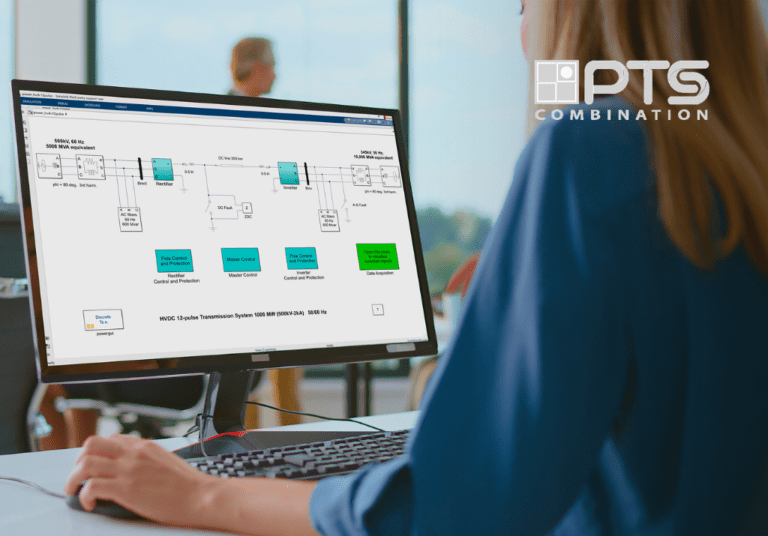

Die Kompatibilität der Toolchain reduziert den Nachbearbeitungsaufwand, wenn Modelle zwischen Teams ausgetauscht werden.

Die Kompatibilität der Toolchain ist wichtig, da die meisten Modellierungsarbeiten gemeinschaftlich und in mehreren Schritten erfolgen und nicht von einer Person mit einem einzigen Tool durchgeführt werden. Wenn Modelle nahtlos zwischen Toolchains übertragen werden können, können Teams ihre Zeit darauf verwenden, die Physik und Steuerung zu verbessern, anstatt Blöcke neu zu erstellen, erneut zu testen und Ergebnisse zu validieren, die bereits in einem anderen Format vorliegen.

Kompatibilität beginnt mit der Auswahl von Darstellungen, die den Austausch überstehen, wie klare Komponentengrenzen, explizite Schnittstellen und Parametersätze, die nicht von versteckten Tool-Standardeinstellungen abhängen. Dateiformate sind wichtig, aber Kompatibilität umfasst auch Solver-Annahmen, Initialisierungsregeln und die Art und Weise, wie Ereignisse behandelt werden. Ein Modell, das auf undokumentierten Standardtoleranzen basiert, verhält sich nach dem Austausch anders, auch wenn die Topologie identisch aussieht.

Kompromisse sind unvermeidlich. Die am besten übertragbare Darstellung kann den Zugriff auf werkzeugspezifische Funktionen einschränken, während ein werkzeugoptimiertes Modell Sie an einen bestimmten Arbeitsablauf binden kann. Gute Teams trennen „Studienmodelle” von „Implementierungsmodellen” und einigen sich dann darauf, wo die Genauigkeit übereinstimmen muss und wo sie abweichen kann, damit sich die Kompatibilitätsarbeit auf die Teile konzentriert, die sich auf die Ergebnisse auswirken.

Die Datenausrichtung sorgt dafür, dass Parameter, Einheiten und Signale überall konsistent bleiben.

Durch die Datenanpassung wird verhindert, dass sich die Bedeutung der Zahlen in Ihrem Modell ändert, wenn sie eine Grenze überschreiten. Einheiten, Skalierungen, Benennungen und Signaldefinitionen müssen über alle Tools, Tabellenkalkulationen, Skripte und Berichte hinweg konsistent sein. Bei einer unzureichenden Anpassung können Teams aus den falschen Gründen zu „richtigen” Diagrammen gelangen und die Diskrepanz erst spät entdecken.

Ein anschauliches Beispiel dafür ist, wie die Handhabung von Einheiten selbst bei korrekten Gleichungen über das Ergebnis entscheiden kann. Eine fehlerhafte Einheitenumrechnung trug zum Verlust eines 125 Millionen Dollar teuren Raumfahrzeugs bei, nachdem ein System Werte in imperialen Einheiten lieferte, während ein anderes metrische Einheiten verwendete. Modellierungsteams stehen vor derselben Art von Fehler, wenn eine Parametertabelle einen bestimmten Satz von Basiseinheiten verwendet, die Simulation jedoch von einem anderen ausgeht.

Die Angleichung verbessert Arbeitsabläufe, wenn Sie Daten als Produkt mit Validierungsregeln behandeln. Metadaten zu Einheiten sollten an Parameter und Signale angehängt werden und nicht impliziert sein. Namen sollten stabil und beschreibend sein, und die Skalierung sollte an Schnittstellen explizit sein, damit Werte nicht mit versteckten Gewinnen „fixiert” werden. Sobald die Datenangleichung konsistent ist, verlagert sich die Fehlersuche von der Verfolgung von Konvertierungen hin zur Überprüfung des tatsächlichen Systemverhaltens.

Der Systemaustausch erfordert gemeinsame Schnittstellen für Modelle, Ergebnisse und Metadaten.

Der Systemaustausch funktioniert, wenn Sie mehr als nur eine Modelldatei austauschen. Teams benötigen ein gemeinsames Paket, das das Modell, seine Parametersätze, die Laufkonfiguration und die für die Reproduktion der Ergebnisse erforderlichen Mindestmetadaten enthält. Ohne dieses Paket kommt es beim Austausch zu Diskussionen darüber, ob das Modell auf dem eigenen Rechner läuft.

Legen Sie fest, was bei jeder Übergabe ausgetauscht wird, und halten Sie dies konsistent ein. Das Austauschpaket sollte Schnittstellendefinitionen, Parameterwörterbücher, Einheitsanmerkungen, Initialisierungseinstellungen und eine kleine Auswahl erwarteter Ergebnisse enthalten, die als Abnahmeprüfungen dienen. Auch die Ergebnisse sind wichtig: Ein Basis-Durchlauf mit protokollierten Signalen hilft dem empfangenden Team zu bestätigen, dass es dasselbe System verwendet und nicht nur ein ähnliches.

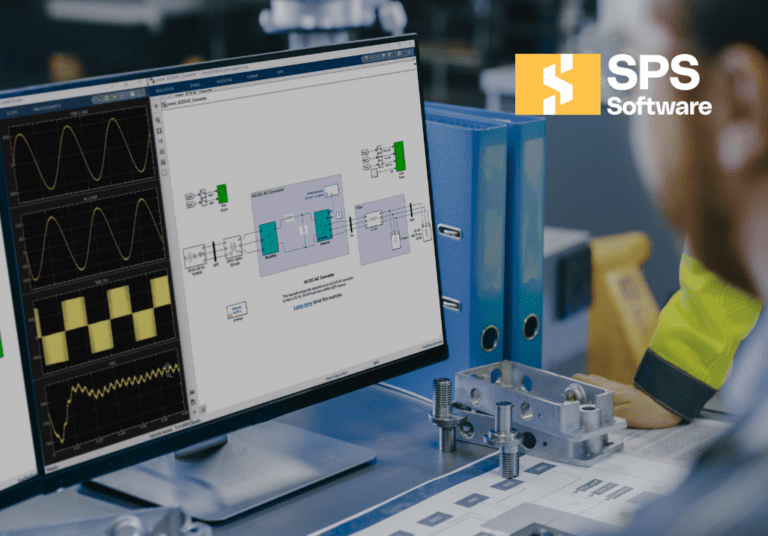

Die Ausführung verbessert sich, wenn das Austauschformat der tatsächlichen Arbeitsweise der Mitarbeiter entspricht. Benutzer von SPS SOFTWARE profitieren beispielsweise von Austauschpaketen, mit denen Komponentenformeln überprüfbar und Parameterwerte nachvollziehbar bleiben, da Prüfer die Absicht überprüfen können, ohne zu erraten, was sich in einem geschlossenen Block befindet. Das gleiche Prinzip gilt für jede Toolchain: Gemeinsame Artefakte sollten die Überprüfung, Reproduktion und kontrollierte Änderung unterstützen.

| Was Sie für den Austausch standardisieren | Was nach einer Übergabe unverändert bleibt |

|---|---|

| Schnittstellensignale mit Namen, Einheiten und Vorzeichenkonventionen | Teams interpretieren Eingaben und Ausgaben über alle Tools hinweg auf die gleiche Weise. |

| Als versionierte Wörterbücher gespeicherte Parametersätze | Die Läufe bleiben auch nach der Optimierung und Umgestaltung reproduzierbar. |

| Initialisierungsregeln und Betriebspunkte | Das Startverhalten ist identisch, sodass frühe Transienten vergleichbar bleiben. |

| Ausführungskonfiguration einschließlich Solver-Annahmen und Toleranzen | Numerische Unterschiede werden nicht mit physikalischen Unterschieden verwechselt. |

| Basis-Ergebnisse mit vereinbarten Akzeptanzsignalen | Empfänger können die Gleichwertigkeit bestätigen, bevor sie neue Arbeiten hinzufügen. |

| Metadaten, die Umfang, Auslassungen und Gültigkeitsbeschränkungen angeben | Modelle werden nicht außerhalb der Bedingungen wiederverwendet, für die sie erstellt wurden. |

Die Klarheit des Arbeitsablaufs ergibt sich aus eindeutigen Zuständigkeiten, Versionen und Übergaben.

Durch einen klaren Workflow wird verhindert, dass Interoperabilitätsarbeiten zu persönlichem Wissen werden. Dank klarer Zuständigkeiten, Versionsregeln und Übergabepunkten ist ersichtlich, wer was ändern kann, wann Änderungen überprüft werden und wie ein Modell vom Entwurf zum vertrauenswürdigen Modell wird. Diese Klarheit verhindert, dass die Modellierung durch mehrere Teams fragmentiert wird.

Machen Sie Übergaben explizit und leichtgewichtig und behandeln Sie sie dann als Teil der technischen Praxis. Die Verantwortung sollte sowohl die Modellstruktur als auch die Datentabellen umfassen, da beides eine Studie beeinträchtigen kann. Versionskennungen sollten Modelländerungen mit Studienergebnissen verknüpfen, damit ein überraschendes Ergebnis auf eine bestimmte Änderung zurückgeführt werden kann. Übergaben sollten eine kurze Abnahmeprüfung beinhalten, damit der Empfänger die Gleichwertigkeit bestätigt, bevor er darauf aufbaut.

- Weisen Sie einen Eigentümer für Schnittstellen und einen Eigentümer für Parameterdaten zu.

- Kennzeichnen Sie jedes freigegebene Modell mit einer Version und einer kurzen Änderungsnotiz.

- Verwenden Sie eine feste Übergabe-Checkliste, die Einheiten und Zeichenprüfungen enthält.

- Speichern Sie die Ergebnisse der Basisausführung zusammen mit dem Modell und nicht in persönlichen Ordnern.

- Überprüfung erforderlich, bevor Schnittstellensignale oder Parameternamen geändert werden.

Diese Regeln reduzieren Nacharbeiten, da sie den Raum verkleinern, in dem sich stille Änderungen verstecken können. Außerdem machen sie die Zusammenarbeit für Studenten und neue Ingenieure sicherer, da die Erwartungen schriftlich festgehalten werden. Klare Arbeitsabläufe beseitigen zwar keine technischen Meinungsverschiedenheiten, sorgen aber dafür, dass sich diese auf technische Aspekte konzentrieren und nicht auf archäologische Fragen.

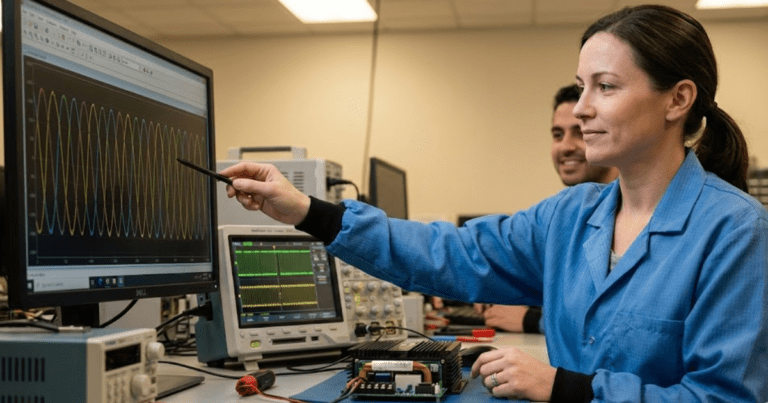

Prüfungen, die Fehler beim Verknüpfen von Physik- und Steuerungsmodellen verhindern

Die Verknüpfung von Physik- und Steuerungsmodellen scheitert auf vorhersehbare Weise, und eine kleine Reihe von Überprüfungen verhindert die meisten davon. Das Ziel ist Konsistenz über alle Bereiche hinweg, nicht perfekte Modellierung. Schnittstellenprüfungen, Einheitsprüfungen und Regressionsprüfungen erkennen Unstimmigkeiten frühzeitig, bevor Teams wochenlang damit verbringen, einen Controller an ein falsch verdrahtetes Anlagenmodell anzupassen.

Beginnen Sie mit Schnittstellenprüfungen, bei denen jede Grenze als Vertrag behandelt wird. Eingaben und Ausgaben sollten unter einem bekannten Betriebspunkt erwartete Bereiche, Einheiten und stationäre Werte aufweisen. Fügen Sie Regressionsprüfungen hinzu, bei denen nach jeder strukturellen Änderung ein kleiner Basisfall erneut ausgeführt wird und wichtige Signale innerhalb vereinbarter Toleranzen verglichen werden. Führen Sie auch numerische Plausibilitätsprüfungen durch, da Schrittweite, Ereignisbehandlung und Initialisierung die Stabilität und Dämpfung ohne physikalische Änderungen beeinflussen können.

„Interoperabilität ist kein von der Modellqualität getrennter Arbeitsbereich, sondern Teil der Modellqualität.“

Teams, die disziplinierte Kontrollen durchführen, erzielen schneller eine Einigung, erhalten klarere Bewertungen und erleben weniger Überraschungen in späten Phasen, wenn die Arbeit die Toolchain des ursprünglichen Autors verlässt. SPS SOFTWARE eignet sich gut, wenn Sie transparente, überprüfbare Modelle zur Unterstützung dieser Kontrollen wünschen, da Überprüfungen Spekulationen reduzieren und Teams dabei helfen, zu einem gemeinsamen Verständnis zu gelangen.