Wichtigste Erkenntnisse

- Die Modellqualität bleibt hoch, wenn Zweck, Evidenz und Wiederholbarkeit aufeinander abgestimmt sind.

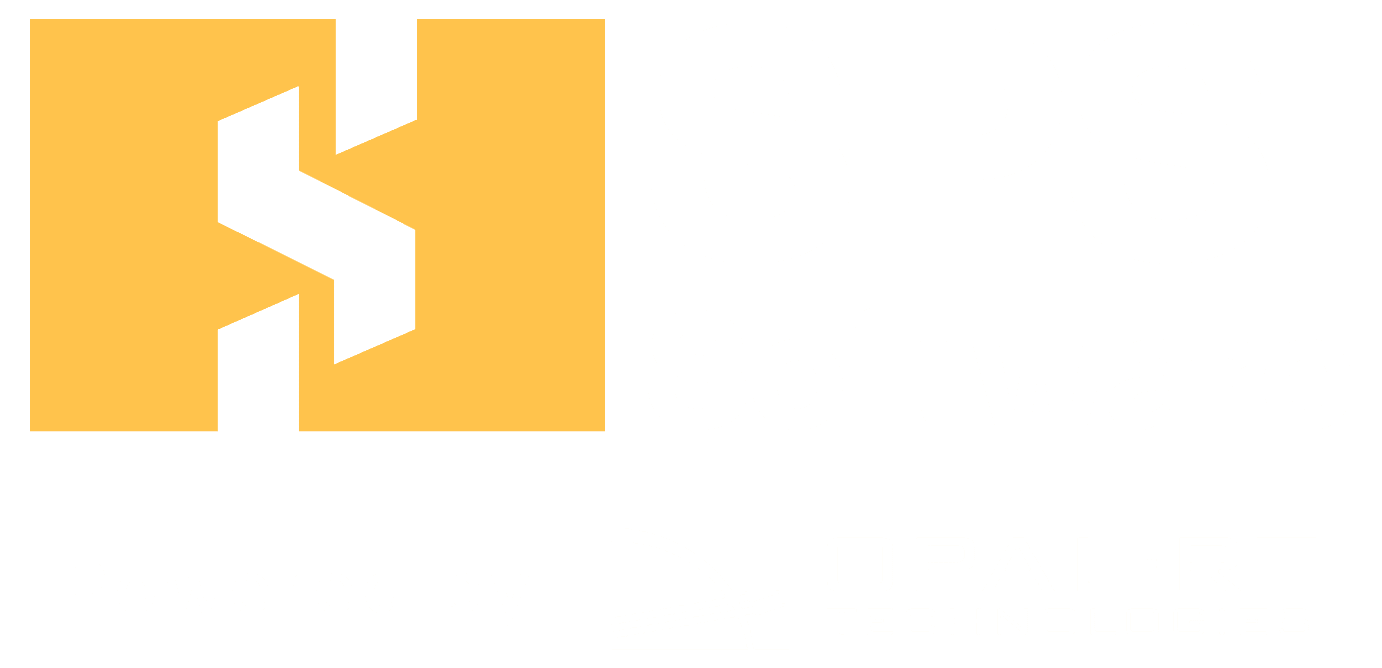

- Eine Bewertungs-Scorecard wandelt Bewertungskriterien in eine einheitliche Punktzahl und klareres Feedback um.

- Gemeinsame Kriterien für Schüler und Lehrkräfte sorgen für eine gerechtere Benotung und festigen Gewohnheiten.

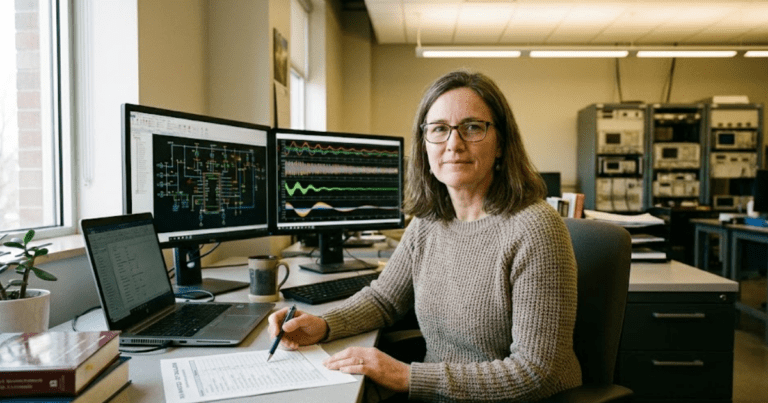

Sie können die Qualität eines Modells schneller und fairer beurteilen, wenn Sie es anhand klarer Kriterien bewerten und nicht nach Ihrem Bauchgefühl. Formative Feedback-Zyklen zeigen messbare Fortschritte; eine Synthese ergab eine mittlere Effektgröße von 0,32. Das gleiche Muster zeigt sich in Ingenieurslabors, da wiederholte Überprüfungen besser sind als eine einzige große Bewertung. Durch konsistente Bewertungen wird das Modellieren von einer Vermutung zu einer Gewohnheit, die Sie verteidigen können.

Bei der Modellqualität geht es nicht darum, möglichst viele Blöcke in ein Diagramm zu packen. Qualität bedeutet, dass Ihr Modell die Frage beantwortet, die es zu beantworten vorgibt, und zwar mit Ergebnissen, die Sie erklären und wiederholen können. Schüler verbessern sich schneller, wenn die Bewertung wie ein kleiner Testplan mit protokollierten Nachweisen aussieht. Pädagogen benoten mit weniger Aufwand, wenn die gleichen Nachweise für alle sichtbar sind.

Was Schüler meinen, wenn sie die Qualität eines Modells bewerten

Studierende bewerten die Qualität eines Modells, wenn sie entscheiden, ob ein Modell für den angegebenen Zweck geeignet ist. Die Überprüfung umfasst nicht nur eine saubere Darstellung, sondern auch Korrektheit, Klarheit und Wiederholbarkeit. Ein Modell ist von hoher Qualität, wenn eine andere Person es ausführen und das gleiche Ergebnis erzielen kann. Ein Modell gilt als von geringer Qualität, wenn seine Ergebnisse von versteckten Anpassungen oder fehlendem Kontext abhängen.

Ein Mikronetz-Labormodell macht dies schnell deutlich. Ein Student stimmt eine Spannungsabfallreaktion ab, bis die Wellenform richtig aussieht, vergisst dann aber, die verwendete Quellenimpedanz anzugeben. Ein Laborpartner führt dieselbe Datei aus und sieht eine andere Abfalltiefe, kann die Diskrepanz jedoch nicht erklären. Die Qualität sinkt, da die Geschichte des Modells nicht wiederholbar ist.

Eine gute Bewertung beginnt mit einer einfachen Frage: Was unterstützt dieses Modell und was nicht? „Läuft ohne Fehler“ ist eine niedrige Messlatte für Ingenieursarbeit. Ein Modell, das läuft, kann dennoch gegen Einheiten, Vorzeichenkonventionen oder den Energiehaushalt verstoßen. Bei der Bewertung verlagert sich der Fokus von „Hat es funktioniert?“ zu „Hat es etwas bewiesen?“.

Die wichtigsten Kriterien, anhand derer Studierende die Qualität von Modellen beurteilen

Die meisten studentischen Bewertungen basieren auf einer kleinen Reihe von Bewertungskriterien, die für alle Kurse gelten. Genauigkeit ist wichtig, muss aber mit einer Referenz verbunden sein, die Sie verteidigen können. Konsistenzprüfungen sind wichtig, da sie Fehler ohne zusätzliche Daten aufdecken. Transparenz ist wichtig, da versteckte Annahmen die Begutachtung durch Gleichaltrige und die Benotung beeinträchtigen.

Eine RLC-Sprungantwortzuordnung konkretisiert die Kriterien. Ein starkes Modell entspricht dem erwarteten Dämpfungsverhältnis, bewahrt die Einheitlichkeit der Einheiten und zeigt die Quelle der Anfangsbedingungen auf. Ein schwaches Modell passt erst nach zufälligen Parameteränderungen zum Diagramm und verbirgt diese Änderungen dann in Subsystemen. Die gleichen Kriterien gelten auch für Feeder, Konverter und Schutzlogikmodelle.

Wir vertrauen einem Modell, wenn wir jedes Ergebnis auf Belege zurückführen können. Genauigkeit ohne Rückverfolgbarkeit schafft kein Vertrauen, da niemand nachvollziehen kann, warum die Übereinstimmung zustande gekommen ist. Rückverfolgbarkeit ohne Genauigkeit ist ebenfalls unzureichend, da das Modell die Aufgabe nicht erfüllt. Die Qualität bleibt hoch, wenn Sie die Kriterien ausgewogen gestalten und sich an den Schwerpunkten des Bewerters orientieren.

„Die Bewertung verlagert den Fokus von „Hat es funktioniert?“ zu „Hat es etwas bewiesen?“

Wie Schüler eine Bewertungs-Scorecard erstellen, die konsistent bleibt

Eine Bewertungs-Scorecard macht die Modellüberprüfung zu einer wiederholbaren Bewertung. Sie definieren Kriterien, verknüpfen diese mit Belegen und bewerten jedes Mal auf die gleiche Weise. Konsistenz ist besser als eine ausgeklügelte Gewichtung, da Bewerter wiederholbaren Überprüfungen vertrauen. Selbstüberprüfungen gehen schneller, wenn die Belege eindeutig sind.

Uneinigkeit nimmt ab, wenn die Bewertungskarte Nachweise verlangt. Eine veröffentlichte Studie berichtete von einer Gesamt-Interrater-Reliabilität (ICC) von 0,7, wenn Bewerter dieselbe Arbeit anhand einer gemeinsamen Rubrik bewerteten. Schüler können dies nachahmen, indem sie jede Bewertungsstufe an einem Artefakt festmachen, nicht an einem Gefühl.

| Zu prüfender Aspekt | Wie eine starke Modellqualität aussieht | Wie eine schwache Modellqualität aussieht |

| Zweckausrichtung | Das Modell beantwortet eine klar formulierte Frage und konzentriert sich von Anfang bis Ende auf diese Aufgabe. | Das Modell enthält zusätzliches Verhalten, das die angegebene Aufgabe nicht unterstützt oder davon ablenkt. |

| Sichtbarkeit von Annahmen | Alle vereinfachenden Annahmen werden schriftlich festgehalten und ihre Auswirkungen auf die Ergebnisse erläutert. | Annahmen sind impliziert oder versteckt, was die Interpretation oder Vertrauenswürdigkeit der Ergebnisse erschwert. |

| Nachweis der Richtigkeit | Die Ergebnisse werden durch Referenzprüfungen, Plausibilitätstests oder erwartetes physikalisches Verhalten gestützt. | Die Ergebnisse basieren ausschließlich auf visueller Übereinstimmung oder Abstimmung ohne Begründung. |

| Wiederholbarkeit der Ergebnisse | Eine andere Person kann das Modell ausführen und mit denselben Eingaben dieselben Ergebnisse erzielen. | Die Ergebnisse ändern sich, wenn jemand anderes das Modell ausführt oder wenn Dateien erneut geöffnet werden. |

| Transparenz der Parameter | Wichtige Parameter, Einheiten und Anfangsbedingungen sind leicht zu finden und zu verstehen. | Wichtige Werte sind in Subsystemen verborgen oder es fehlen Einheiten und Kontext. |

| Überprüfungsbereitschaft | Das Modell enthält Anmerkungen oder Artefakte, die die Benotung und Begutachtung durch Gleichaltrige unterstützen. | Das Modell erfordert eine verbale Erklärung, da unterstützende Belege fehlen. |

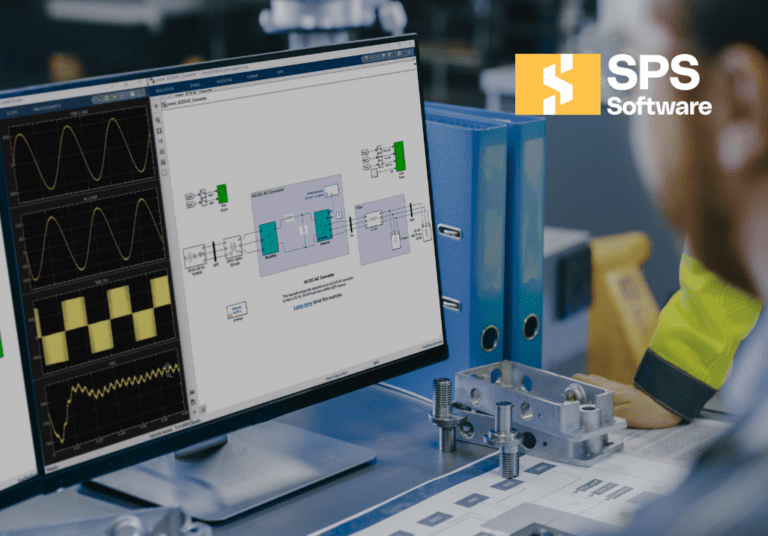

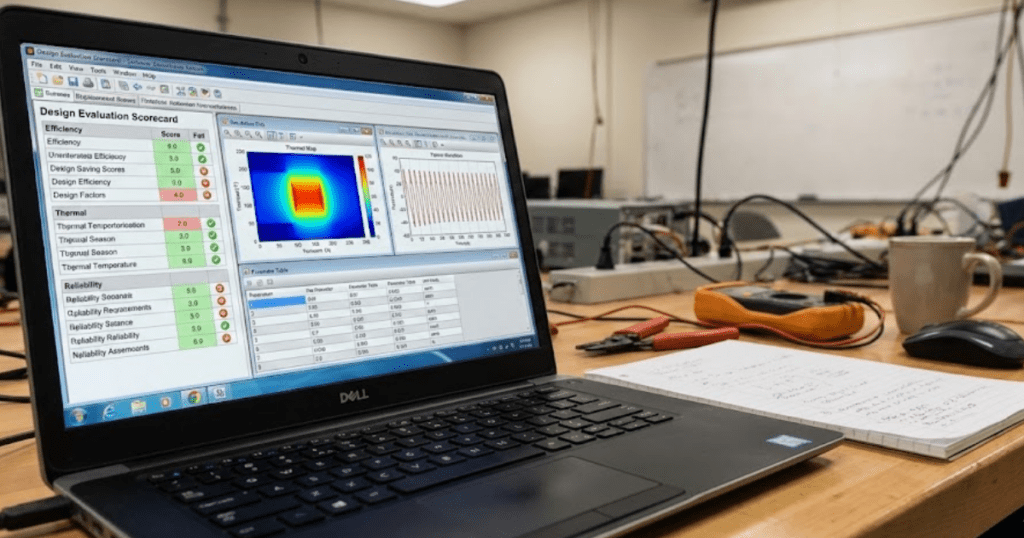

Transparente Modelle erleichtern die Anwendung von Scorecards, da Sie auf Gleichungen und Parameter verweisen können. SPS SOFTWARE unterstützt diesen Stil, wenn Labore überprüfbare Modelle zur Überprüfung benötigen. Klarheit reduziert Diskussionen und Neubewertungen. Das Feedback wird präziser, da jede Lücke einer Zeile zugeordnet ist.

Die Reihenfolge, die die Schüler beim Überprüfen eines technischen Modells befolgen

Eine gute Überprüfungsreihenfolge spart Zeit, da frühzeitige Überprüfungen die größten Fehler aufdecken. Beginnen Sie mit Zweck und Umfang, überprüfen Sie dann die Struktur und führen Sie einfache Plausibilitätstests durch, bevor Sie die Ergebnisse beurteilen. Diese Reihenfolge verhindert, dass Sie ein fehlerhaftes Modell optimieren. Notizen werden für Kollegen und Lehrkräfte leichter nachvollziehbar.

- Bestätigen Sie den Zweck, die Eingaben und die erwarteten Ergebnisse.

- Überprüfen Sie die Topologie und die Beschriftungen anhand des Referenzschaltplans.

- Führen Sie Plausibilitätsprüfungen für Einheiten, Grenzwerte und Anfangszustände durch.

- Vergleichen Sie wichtige Ergebnisse mit einer analytischen Überprüfung oder einem Basis-Lauf.

- Durchgeführte Tests und gesammelte Beweise aufzeichnen

Ein Laborpartner, der ein Konvertermodell überprüft, kann diese Schritte in wenigen Minuten durchführen. Der Prüfer bestätigt die Schaltfrequenz und die Regelungsziele und überprüft anschließend die Verkabelung der Leistungsstufe. Bei einem Leerlauf sollte der Strom nahe Null und die Spannungen im Bereich bleiben. Erst dann sollte der Prüfer die Effizienz oder die Wellenform beurteilen.

Spätere Tests setzen voraus, dass frühere Überprüfungen korrekt sind. Das Einstellen des Controllers vor der Überprüfung der Sensorskalierung kostet Stunden Zeit und führt dennoch zu einer schlechten Note. Die Reihenfolge reduziert Verzerrungen bei der gegenseitigen Bewertung, da alle denselben Weg gehen. Lehrkräfte benoten schneller, wenn die Schritte der Schülerbewertung mit dem Arbeitsablauf der Benotenden übereinstimmen.

Wie Annahmen und Umfang die Qualitätsbewertungen von Studierenden beeinflussen

Annahmen und Umfang definieren, was „richtig“ für Ihr Modell bedeutet. Ein Modell kann innerhalb seines Umfangs ausgezeichnet und außerhalb davon nutzlos sein. Studierende, die den Umfang klar formulieren, vermeiden unfaire Kritik, da die Prüfer wissen, was absichtlich weggelassen wurde. Pädagogen belohnen einen klaren Umfang, da er technisches Urteilsvermögen zeigt.

Eine Aufgabe im Bereich der Leistungselektronik, die auf die Stabilität des Regelkreises abzielt, veranschaulicht diesen Kompromiss. Ein gemitteltes Wandlermodell gibt eine klare Antwort auf die Frage nach der Stabilität, während ein Schaltmodell diese unter Welligkeit und Sprunggrößenrauschen begraben würde. Die Mittelungsannahme ist gültig, wenn Sie die Frequenztrennung angeben und erklären, warum die Welligkeit nicht die Messgröße ist. Die Qualität steigt, weil das Modell zur Aufgabe passt.

Der Umfang bestimmt auch, welche Tests durchgeführt werden sollten. Eine Netzwerkstudie auf EMT-Ebene erfordert Überprüfungen des Zeitschritts, der Solver-Grenzwerte und der numerischen Stabilität, während eine RMS-Studie im stationären Zustand Überprüfungen der Bilanz und der Phasor-Annahmen erfordert. Studenten verlieren Punkte, wenn sie das Falsche testen und dann behaupten, das Modell sei „validiert“. Ein klarer Umfang sorgt dafür, dass die Tests mit dem übereinstimmen, was das Modell darstellen soll.

Häufige Fehler, die Schüler bei der Bewertung der Modellqualität machen

Studierende bewerten Modelle oft eher anhand der Ergebnisse als anhand von Belegen. Diese Gewohnheit belohnt optimierte Modelle und benachteiligt Modelle, die ihre Arbeit dokumentieren. Ein weiterer Fehler ist die Vermischung von Kritik an der Idee mit Kritik an der Umsetzung. Die Qualitätsbewertung sollte sich darauf konzentrieren, was das Modell beweist, und nicht darauf, was man sich wünscht, dass es beweist.

Ein klassischer Fehler tritt auf, wenn eine einzige nominale Wellenformübereinstimmung die Überprüfung beendet. Das Modell besteht den nominalen Fall, versagt jedoch bei einer kleinen Änderung, wie z. B. einem Lastsprung oder einer Verschiebung der Fehlerimpedanz. Ein weiterer Fehler tritt auf, wenn Zeitschritte aus Gründen der Geschwindigkeit gewählt werden, wodurch die Dynamik verzerrt und Instabilitäten verdeckt werden. Überprüfungskriterien, die Wiederholbarkeits- und Empfindlichkeitsprüfungen umfassen, erkennen beide Probleme.

Die Selbstbewertung scheitert auch, wenn die Dokumentation übersprungen wird, weil das Modell „offensichtlich“ ist. Fehlende Einheiten, Anfangszustände oder Parameterquellen blockieren die Benotung und die Begutachtung durch Gleichaltrige. Die Studierenden verlieren auch Punkte, wenn sich ein Wert ohne Vermerk ändert, sodass das endgültige Modell keinen Prüfpfad aufweist. Eine Scorecard zwingt zur Disziplin, da jede Zeile ein bestimmtes Artefakt benötigt.

„Das abschließende Urteil ist einfach: Eine disziplinierte Bewertung ist Teil der Ingenieursarbeit und kein zusätzlicher Verwaltungsaufwand.“

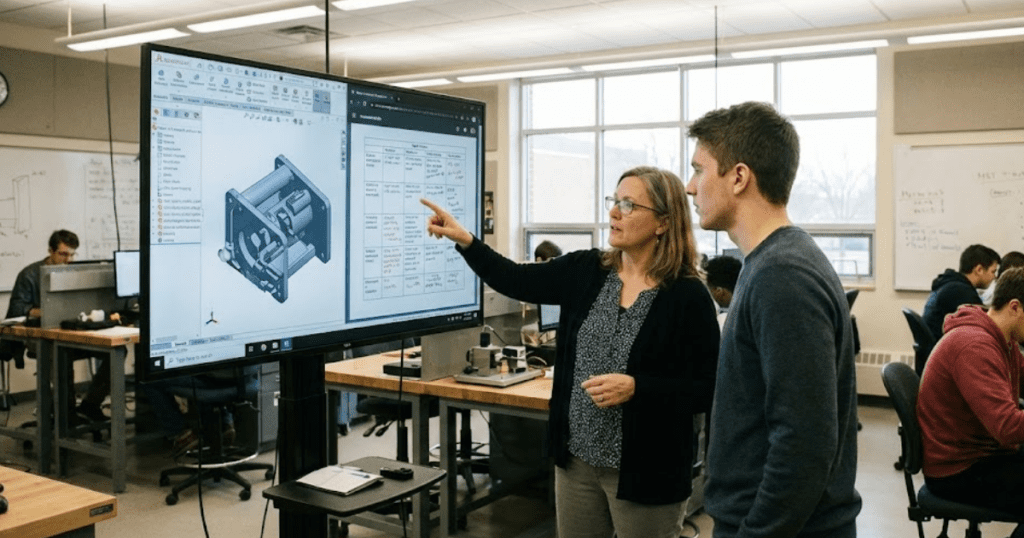

Wie Pädagogen Feedback mit den Bewertungskriterien für Schüler in Einklang bringen

Pädagogen bewerten Schülermodelle am besten, wenn das Feedback auf dieselben Kriterien verweist, die die Schüler für ihre Bewertung herangezogen haben. Klare Kriterien reduzieren Diskussionen über Stilfragen und lenken die Aufmerksamkeit auf das, was das Modell unterstützt. Ausrichtung bedeutet auch, dass Pädagogen anhand des gleichen Formats, das für die Bewertung verwendet wird, zeigen, wie „gut“ aussieht. Schüler lernen schneller, wenn das Feedback in den nächsten Test einfließt, den Sie durchführen sollten.

Die Kalibrierung vor der Benotung sorgt für einheitliche Bewertungen in allen Bereichen. Zwei Benotende bewerten dasselbe Mustermodell, vergleichen ihre Notizen und passen die Formulierungen der Bewertungsbögen an, bis die Bewertungen übereinstimmen. Die Schüler können dies bei der gegenseitigen Bewertung nachahmen, indem sie die Modelle austauschen und unabhängig voneinander bewerten und dann jeweils eine Abweichung nach der anderen besprechen. Das Ergebnis sind fairere Bewertungen und festere Gewohnheiten.

Das Fazit ist einfach: Eine disziplinierte Bewertung ist Teil des Ingenieurwesens und kein zusätzlicher Verwaltungsaufwand. Studierende, die Bewertungskriterien als Testplan betrachten, erstellen Modelle, die während ihrer Ausführung lehrreich sind. Lehrkräfte, die ihre Kommentare an der Bewertungsliste ausrichten, müssen weniger Zeit damit verbringen, Noten zu verteidigen, und haben mehr Zeit für die Betreuung ihrer Studierenden. SPS SOFTWARE unterstützt diesen Ansatz, wenn Labore transparente, überprüfbare Modelle wünschen, mit denen sich Nachweise leicht erbringen lassen.