Principaux enseignements

- La qualité du modèle reste élevée lorsque l'objectif, les preuves et la répétabilité restent alignés.

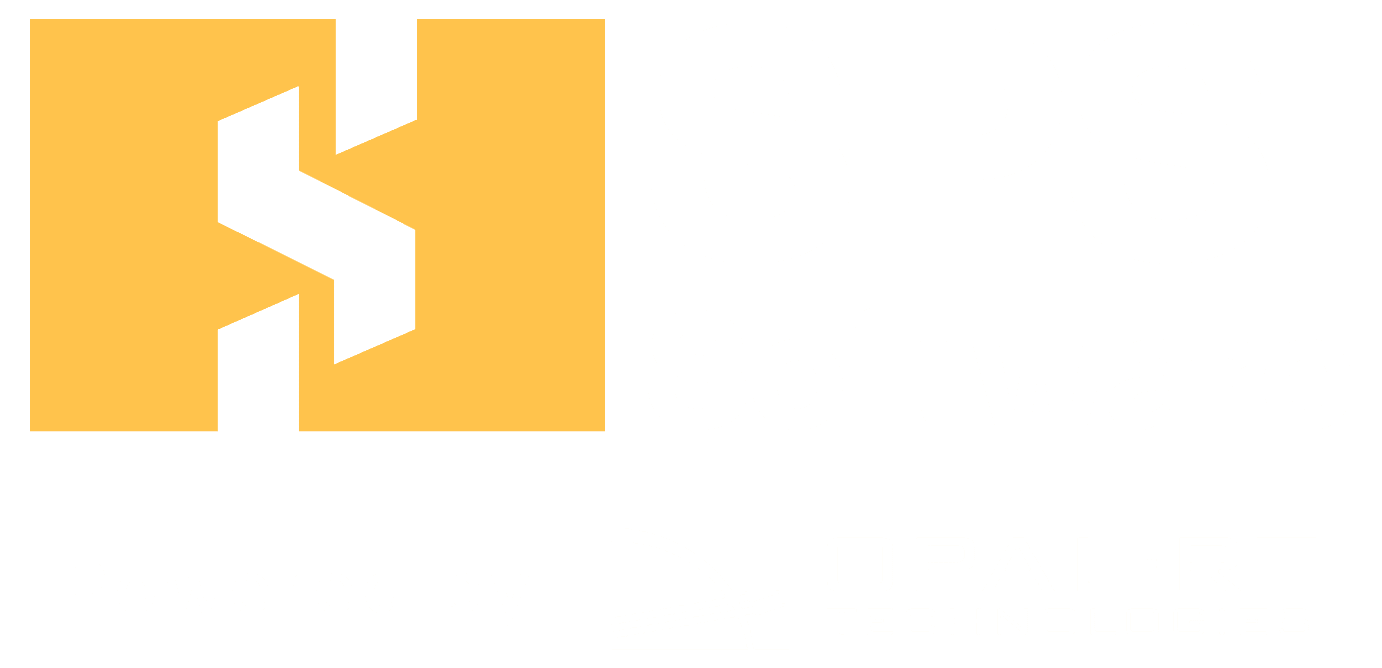

- Une fiche d'évaluation transforme les critères d'évaluation en une notation cohérente et en un retour d'information plus clair.

- Des critères communs aux élèves et aux enseignants rendront la notation plus équitable et renforceront les habitudes.

Vous jugerez plus rapidement et plus équitablement la qualité d'un modèle lorsque vous l'évaluerez selon des critères clairs, et non selon votre intuition. Les cycles de rétroaction formative montrent des gains mesurables ; une synthèse a rapporté un effet moyen de 0,32. Le même schéma se retrouve dans les laboratoires d'ingénierie, car des contrôles répétés sont plus efficaces qu'une seule grande note. Une évaluation cohérente transformera la modélisation d'une simple conjecture en une habitude que vous pourrez défendre.

La qualité d'un modèle ne consiste pas à remplir un diagramme avec le plus grand nombre possible de blocs. La qualité signifie que votre modèle répondra à la question qu'il prétend répondre, avec des résultats que vous pouvez expliquer et reproduire. Les élèves progressent plus rapidement lorsque l'évaluation ressemble à un petit plan de test avec des preuves consignées. Les enseignants notent avec moins de bruit lorsque les mêmes preuves sont visibles par tous.

Ce que les élèves entendent lorsqu'ils évaluent la qualité d'un modèle

Les étudiants évaluent la qualité d'un modèle lorsqu'ils déterminent s'il est adapté à l'objectif déclaré. La vérification porte sur l'exactitude, la clarté et la reproductibilité, et pas seulement sur la netteté du graphique. Un modèle est de haute qualité lorsqu'une autre personne peut l'exécuter et obtenir le même résultat. Un modèle est considéré comme de faible qualité lorsque ses résultats dépendent d'ajustements cachés ou d'un contexte manquant.

Un modèle de laboratoire de micro-réseau révèle rapidement ce problème. Un étudiant ajuste la réponse à une chute de tension jusqu'à ce que la forme d'onde semble correcte, puis oublie d'indiquer l'impédance source utilisée. Un partenaire de laboratoire exécute le même fichier et constate une profondeur de chute différente, mais ne parvient pas à expliquer cette divergence. La qualité diminue car le modèle n'est pas reproductible.

Une bonne évaluation commence par une question simple : que prendra en charge ce modèle, et que ne prendra-t-il pas en charge ? « Fonctionne sans erreur » est un critère peu exigeant pour un travail d'ingénierie. Un modèle qui fonctionne peut tout de même enfreindre les unités, les conventions de signe ou l'équilibre énergétique. L'évaluation déplace l'attention de « a-t-il fonctionné » à « a-t-il prouvé quelque chose ».

Les critères fondamentaux utilisés par les étudiants pour juger de la qualité d'un modèle

La plupart des évaluations des étudiants correspondent à un petit ensemble de critères d'évaluation qui s'appliquent à tous les cours. La précision est importante, mais elle doit être liée à une référence que vous pouvez défendre. Les contrôles de cohérence sont importants car ils permettent de détecter les erreurs sans données supplémentaires. La transparence est importante car une hypothèse cachée compromettrait l'évaluation par les pairs et la notation.

Une affectation de réponse échelonnée RLC concrétise les critères. Un modèle solide correspond au rapport d'amortissement attendu, maintient la cohérence des unités et indique la source des conditions initiales. Un modèle faible ne correspond au tracé qu'après des modifications aléatoires des paramètres, puis masque ces modifications dans les sous-systèmes. Les mêmes critères s'appliquent également aux alimentations, aux convertisseurs et aux modèles de logique de protection.

Nous faisons confiance à un modèle lorsque nous pouvons retracer chaque résultat jusqu'à la preuve. La précision sans traçabilité ne suscite pas la confiance, car personne ne peut voir pourquoi la correspondance s'est produite. La traçabilité sans précision échoue également, car le modèle ne répondra pas à la tâche. La qualité reste élevée lorsque vous équilibrez les critères et que vous correspondez à l'objectif du correcteur.

« L'évaluation déplace l'attention de la question « cela a-t-il fonctionné ? » à « cela a-t-il prouvé quelque chose ? ».

Comment les étudiants élaborent une fiche d'évaluation cohérente

Une fiche d'évaluation transforme l'examen des modèles en une notation reproductible. Vous définissez des critères, vous les associez à des preuves et vous attribuez des notes de la même manière à chaque fois. La cohérence l'emporte sur une pondération intelligente, car les évaluateurs font confiance aux contrôles reproductibles. Les auto-évaluations sont plus rapides lorsque les preuves sont claires.

Les désaccords diminuent lorsque la grille d'évaluation exige des preuves. Une étude publiée a rapporté un coefficient de fiabilité inter-évaluateurs (ICC) global de 0,7 lorsque les évaluateurs ont noté le même travail à l'aide d'une grille commune. Les élèves peuvent reproduire cette méthode en associant chaque niveau de note à un élément concret, et non à une impression.

| Aspect vérifié | À quoi ressemble un modèle de qualité supérieure ? | À quoi ressemble un modèle de qualité médiocre ? |

| Alignement des objectifs | Le modèle répond à une question clairement formulée et reste concentré sur cette tâche du début à la fin. | Le modèle inclut des comportements supplémentaires qui ne soutiennent pas la tâche indiquée ou qui détournent l'attention de celle-ci. |

| Visibilité des hypothèses | Toutes les hypothèses simplificatrices sont consignées par écrit et leur incidence sur les résultats est expliquée. | Les hypothèses sont implicites ou cachées, ce qui rend les résultats difficiles à interpréter ou à croire. |

| Preuve de l'exactitude | Les résultats sont corroborés par des vérifications de références, des tests de cohérence ou le comportement physique attendu. | Les résultats reposent uniquement sur un accord visuel ou un ajustement sans justification. |

| Répétabilité des résultats | Une autre personne peut exécuter le modèle et reproduire les mêmes résultats en utilisant les mêmes données d'entrée. | Les résultats changent lorsque quelqu'un d'autre exécute le modèle ou lorsque les fichiers sont rouverts. |

| Transparence des paramètres | Les paramètres clés, les unités et les conditions initiales sont faciles à trouver et à comprendre. | Les valeurs importantes sont enfouies dans des sous-systèmes ou manquent d'unités et de contexte. |

| Préparation à l'examen | Le modèle comprend des notes ou des artefacts qui facilitent la notation et l'évaluation par les pairs. | Le modèle nécessite une explication verbale car les preuves à l'appui font défaut. |

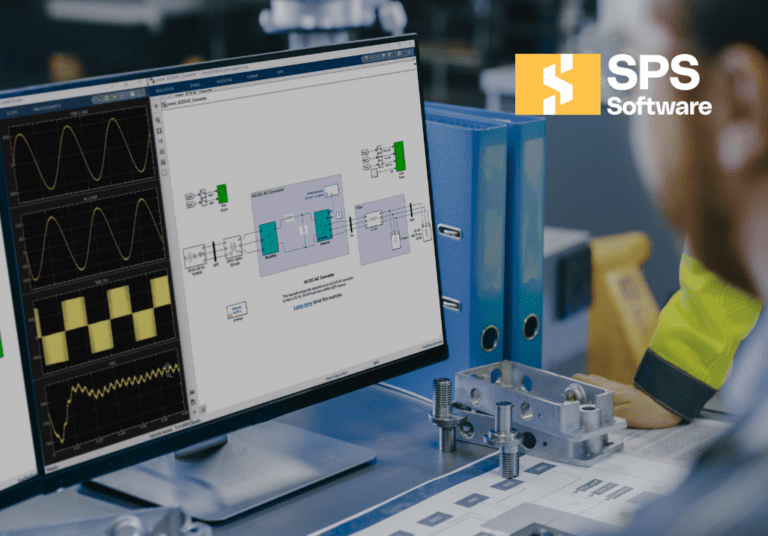

Les modèles transparents facilitent l'application des tableaux de bord, car vous pouvez pointer vers des équations et des paramètres. SPS SOFTWARE prend en charge ce style lorsque les laboratoires ont besoin de modèles vérifiables pour examen. La clarté réduit les débats et les reclassements. Les commentaires sont plus précis, car chaque écart correspond à une ligne.

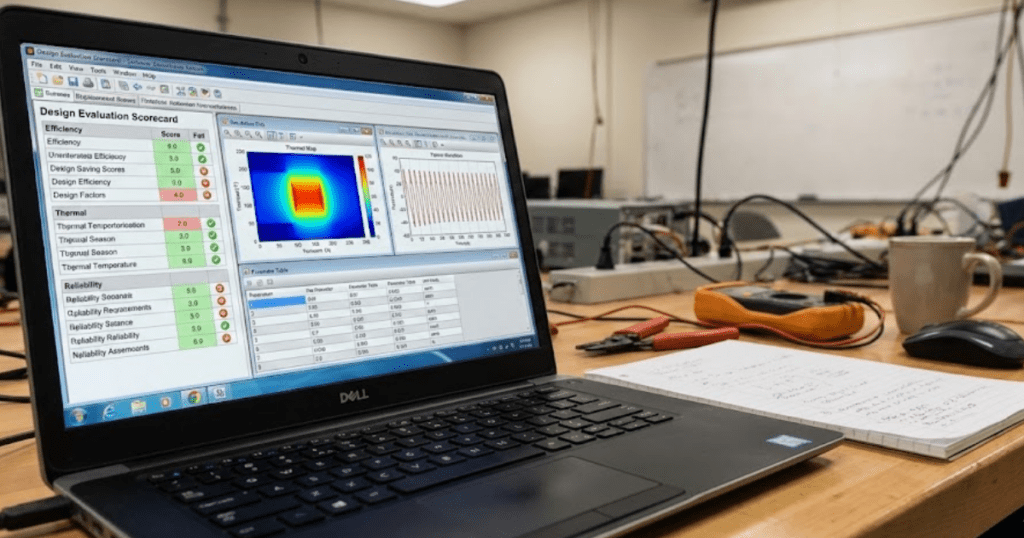

La séquence suivie par les étudiants lors de l'examen d'un modèle technique

Une bonne procédure de révision permet de gagner du temps, car les vérifications précoces permettent de détecter les erreurs les plus importantes. Commencez par définir l'objectif et la portée, puis vérifiez la structure et effectuez des tests de cohérence simples, avant d'évaluer les résultats. Cette procédure vous évite de peaufiner un modèle défaillant. Les notes deviennent plus faciles à suivre pour les pairs et les enseignants.

- Confirmer l'objectif, les intrants et les extrants attendus

- Vérifiez la topologie et les signes par rapport au schéma de référence.

- Effectuer des contrôles de cohérence sur les unités, les limites et les états initiaux

- Comparez les résultats clés à un contrôle analytique ou à une exécution de référence.

- Enregistrer les tests effectués et les preuves recueillies

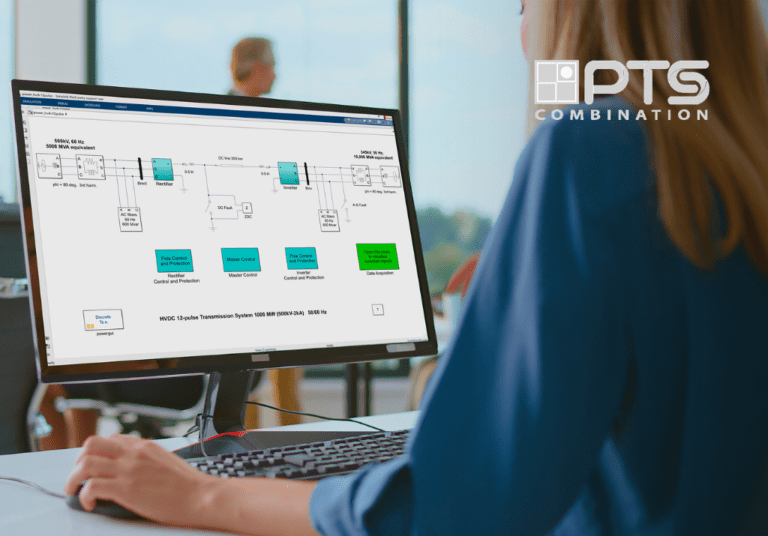

Un partenaire de laboratoire qui examine un modèle de convertisseur peut appliquer ces étapes en quelques minutes. L'examinateur confirme la fréquence de commutation et les cibles de contrôle, puis vérifie le câblage de l'étage de puissance. Un fonctionnement à vide doit maintenir le courant proche de zéro et les tensions dans la plage prévue. Ce n'est qu'alors que l'examinateur peut juger de l'efficacité ou de la forme d'onde.

Les tests ultérieurs supposent que les vérifications précédentes sont correctes. Le réglage du contrôleur avant les vérifications de mise à l'échelle du capteur fera perdre des heures et aboutira tout de même à une note insuffisante. La séquence réduit les biais dans l'évaluation par les pairs, puisque tout le monde suit le même cheminement. Les enseignants notent plus rapidement lorsque les étapes d'évaluation des élèves correspondent au flux de travail du correcteur.

Comment les hypothèses et la portée influencent les évaluations de la qualité des étudiants

Les hypothèses et le champ d'application définissent ce que signifie « correct » pour votre modèle. Un modèle peut être excellent dans son champ d'application et inutile en dehors de celui-ci. Les étudiants qui définissent clairement le champ d'application évitent les critiques injustes, car les évaluateurs savent ce qui a été intentionnellement omis. Les enseignants récompensent la clarté du champ d'application, car elle témoigne d'un jugement technique.

Une tâche d'électronique de puissance qui cible la stabilité de la boucle de contrôle illustre ce compromis. Un modèle de convertisseur moyen répondra clairement à la question de la stabilité, tandis qu'un modèle de commutation la noiera sous le bruit d'ondulation et de taille de pas. L'hypothèse de moyennage est valable lorsque vous indiquez la séparation de fréquence et expliquez pourquoi l'ondulation n'est pas la métrique. La qualité augmente car le modèle correspond à la tâche.

La portée modifie également les tests à effectuer. Une étude de réseau de niveau EMT nécessitera des vérifications du pas de temps, des limites du solveur et de la stabilité numérique, tandis qu'une étude RMS en régime permanent nécessitera des vérifications de l'équilibre et des hypothèses de phaseurs. Les étudiants perdent des points lorsqu'ils testent la mauvaise chose, puis affirment que le modèle est « validé ». Une portée claire permet d'aligner les tests sur ce que le modèle prétend représenter.

Erreurs courantes commises par les étudiants lors de l'évaluation de la qualité d'un modèle

Les étudiants évaluent souvent les modèles en fonction de leur résultat plutôt que des preuves. Cette habitude récompense les modèles ajustés et pénalise ceux qui documentent leur travail. Une autre erreur consiste à confondre la critique de l'idée et la critique de la mise en œuvre. L'évaluation de la qualité doit se concentrer sur ce que le modèle prouve, et non sur ce que vous souhaitez qu'il prouve.

Un échec classique se produit lorsqu'une seule correspondance de forme d'onde nominale met fin à l'examen. Le modèle passe le cas nominal mais échoue sous l'effet d'un petit changement, tel qu'un pas de charge ou un décalage de l'impédance de défaut. Un autre échec apparaît lorsque les pas de temps sont choisis pour la vitesse, ce qui déforme la dynamique et masque les instabilités. Les critères d'examen qui incluent des contrôles de répétabilité et de sensibilité permettront de détecter ces deux problèmes.

L'auto-évaluation échoue également lorsque la documentation est omise parce que le modèle est « évident ». Les unités manquantes, les états initiaux ou les sources de paramètres bloquent la notation et l'évaluation par les pairs. Les étudiants perdent également des points lorsqu'une valeur change sans note, de sorte que le modèle final ne comporte aucune piste d'audit. Une fiche de notation impose une certaine discipline, car chaque ligne doit comporter un élément spécifique.

« Le verdict final est simple : une évaluation rigoureuse fait partie intégrante de l'ingénierie, et ne constitue pas une charge administrative supplémentaire. »

Comment les enseignants alignent leurs commentaires sur les critères d'évaluation des élèves

Les enseignants évaluent mieux les modèles des élèves lorsque leurs commentaires s'appuient sur les mêmes critères que ceux utilisés par les élèves pour noter leurs travaux. Des critères clairs réduisent les discussions sur le style et concentrent l'attention sur ce que le modèle va soutenir. L'alignement signifie également que les enseignants montreront ce qu'est un « bon » travail dans le même format que celui utilisé pour la notation. Les élèves apprennent plus vite lorsque les commentaires se transforment en un nouveau test à réaliser.

L'étalonnage avant la notation permet d'assurer la cohérence des notes entre les sections. Deux correcteurs notent le même modèle d'exemple, comparent leurs notes et ajustent la formulation de la fiche d'évaluation jusqu'à ce que les notes correspondent. Les élèves peuvent reproduire cette méthode lors de l'évaluation par les pairs en échangeant les modèles et en les notant de manière indépendante, puis en discutant d'un écart à la fois. Il en résulte une notation plus équitable et des habitudes plus solides.

Le verdict final est simple : l'évaluation rigoureuse fait partie intégrante de l'ingénierie, et ne constitue pas une charge administrative supplémentaire. Les étudiants qui considèrent les critères d'évaluation comme un plan de test construiront des modèles qui enseignent au fur et à mesure de leur exécution. Les enseignants qui alignent leurs commentaires sur la grille d'évaluation passeront moins de temps à défendre les notes et plus de temps à encadrer leurs étudiants. SPS SOFTWARE soutient cette approche lorsque les laboratoires souhaitent disposer de modèles transparents et vérifiables qui facilitent la présentation des preuves.