Principaux enseignements

- Commencez par définir l'objectif de l'étude, puis adaptez la fiabilité de l'outil et ses résultats à cet objectif afin que ceux-ci restent explicables et défendables.

- Choisissez entre EMT et RMS en fonction des échelles de temps et des phénomènes physiques que vous devez modéliser, car une approche de modélisation inadaptée donnera des résultats qui semblent fiables mais qui sont erronés.

- Privilégiez la transparence des modèles, la stabilité des solveurs et la reproductibilité des flux de travail plutôt que le nombre de fonctionnalités, afin que les équipes et les étudiants puissent réexécuter, examiner et se fier aux mêmes cas.

Choisissez votre outil de simulation en mettant en adéquation les objectifs de l'étude avec la précision du modèle, le comportement du solveur et l'adéquation au flux de travail.

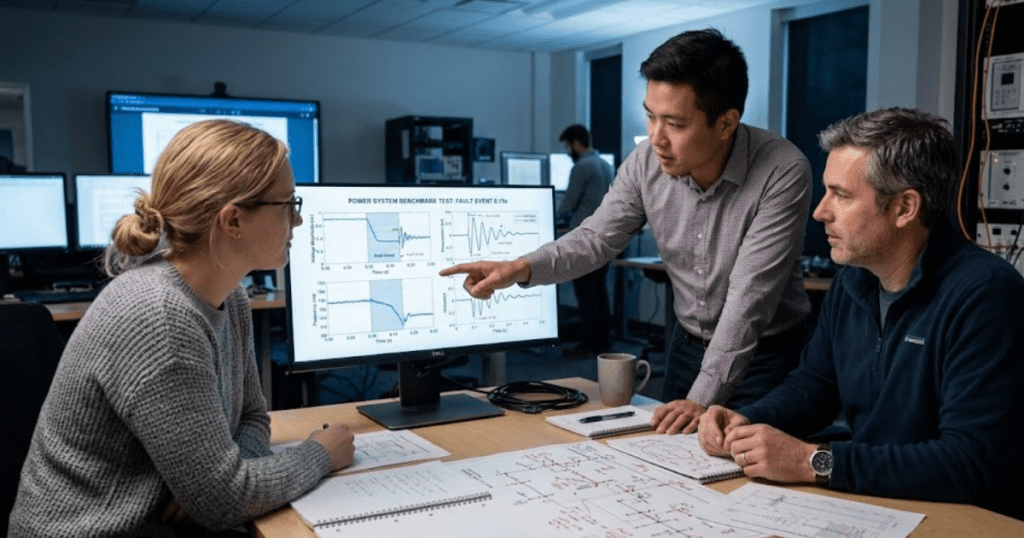

« Le choix d'un outil se passe mal lorsqu'on commence par dresser une liste de fonctionnalités au lieu de se concentrer sur la question à laquelle il faut répondre, les délais à respecter et les résultats auxquels on doit pouvoir se fier. »

L'enseignement doit faire preuve de transparence afin que les étudiants puissent comprendre pourquoi les formes d'onde changent, et pas seulement constater qu'elles changent. L'ingénierie a besoin de résultats reproductibles qui restent stables malgré les variations de paramètres, les mises à jour des modèles et les changements de personnel. Une enquête publiée dans *Nature* a révélé que 70 % des chercheurs avaient tenté, sans succès, de reproduire les expériences d'un autre scientifique, ce qui nous rappelle que la reproductibilité est une exigence technique, et non un simple atout.

Une comparaison pertinente des outils de simulation électrique doit prendre en compte la précision, la facilité d'utilisation et la gouvernance comme un tout. Vous choisissez des hypothèses, des méthodes numériques et la transparence des modèles, et pas seulement une interface utilisateur. Vous devez également prévoir un plan de mise en œuvre au sein d'un laboratoire d'enseignement ou d'une équipe d'ingénieurs, car les questions de licence, de gestion des versions et les habitudes en matière de révision des modèles auront une incidence sur les résultats à long terme. Le meilleur logiciel de simulation de réseaux électriques est celui qui rend vos hypothèses de modélisation visibles et contrôlables, afin que vous puissiez expliquer vos résultats et les justifier.

Commencez par définir les objectifs de l'étude et le niveau de fidélité requis pour la simulation

La première étape de votre évaluation consiste à formuler la question de recherche, à définir les événements que vous devez modéliser et à déterminer les résultats que vous considérerez comme corrects. La fidélité n'est ni « élevée » ni « faible » ; il s'agit d'une adéquation entre l'échelle de temps et les lois de la physique. Si vous ne parvenez pas à définir clairement ce qui doit être pris en compte, vous risquez de surcharger vos modèles ou de passer à côté de comportements essentiels.

Commencez par prendre trois décisions que vous pouvez résumer en quelques lignes : quels phénomènes sont importants, ce que vous allez ignorer et quelle marge d'erreur vous êtes prêt à accepter. La principale différence entre l'enseignement et l'ingénierie réside dans la définition de ce qu'est un « bon » résultat. Un laboratoire d'enseignement privilégie souvent la clarté, des équations de composants vérifiables et une mise en place rapide, afin que les étudiants consacrent leur temps à apprendre plutôt qu'à se débattre avec les aléas techniques. Le travail d'ingénierie privilégie quant à lui la traçabilité, la révision des modèles et la stabilité des simulations sur de nombreux cas, car une seule simulation instable peut invalider tout un ensemble de conclusions.

Une méthode concrète pour garantir cela consiste à définir un « scénario de référence » et un « scénario de contrainte » avant toute installation. Un cours sur les systèmes de protection pourrait définir un test de référence comme un défaut sur une ligne d'alimentation de 12,47 kV avec un onduleur suivant le réseau et une simple vérification de la logique des relais, puis utiliser un test de contrainte qui ajuste la résistance au défaut et les limites de courant de l'onduleur pour vérifier si les résultats restent cohérents. Une fois ces deux tests programmés, chaque essai d'outil devient mesurable plutôt que basé sur des impressions.

Comparaison des approches EMT et RMS pour la modélisation des réseaux électriques

La principale différence entre la simulation EMT et la simulation RMS réside dans ce que le solveur considère comme un état électrique par opposition à une approximation moyennée. La modélisation EMT permet de traiter les transitoires électromagnétiques rapides et les effets de commutation à l'aide de petits pas de temps. La modélisation RMS se concentre sur les dynamiques électromécaniques plus lentes et les grandeurs phasorielles ; elle couvre donc des horizons temporels plus longs tout en nécessitant moins de ressources de calcul.

L'EMT est l'approche à privilégier lorsque votre analyse porte sur la forme des ondes, la rapidité des commandes, le comportement de commutation des convertisseurs, les interactions entre les protections liées aux valeurs instantanées ou les harmoniques. La valeur efficace (RMS) est l'approche à privilégier lorsque votre analyse porte sur le comportement de la tension et de la fréquence sur une durée plus longue, les marges de stabilité ou les variations du point de fonctionnement, dans la mesure où les détails de la forme d'onde n'influencent pas le résultat. Aucune de ces deux approches n'est « meilleure » en soi, et toutes deux peuvent induire en erreur si elles sont utilisées en dehors de leur cadre d'application.

Lors de l'évaluation d'un outil, ne vous arrêtez pas aux arguments marketing et demandez-vous ce que la plateforme résout réellement, comment elle initialise les états, et quelles sont ses hypothèses concernant la fréquence et l'équilibre du réseau. Un outil peut proposer les deux approches, mais vous devez tout de même vérifier comment les modèles effectuent la transition entre les échelles de temps et quels signaux sont disponibles pour la vérification. Une bonne habitude de sélection consiste à choisir d'abord entre l'EMT et le RMS, puis à présélectionner les outils qui effectuent cette tâche correctement, car forcer un outil à s'adapter à un type d'étude inadapté est une cause fréquente de perte de temps lors de la modélisation.

Vérifiez les bibliothèques pour les convertisseurs, les dispositifs de protection, les alimentations et la logique de commande

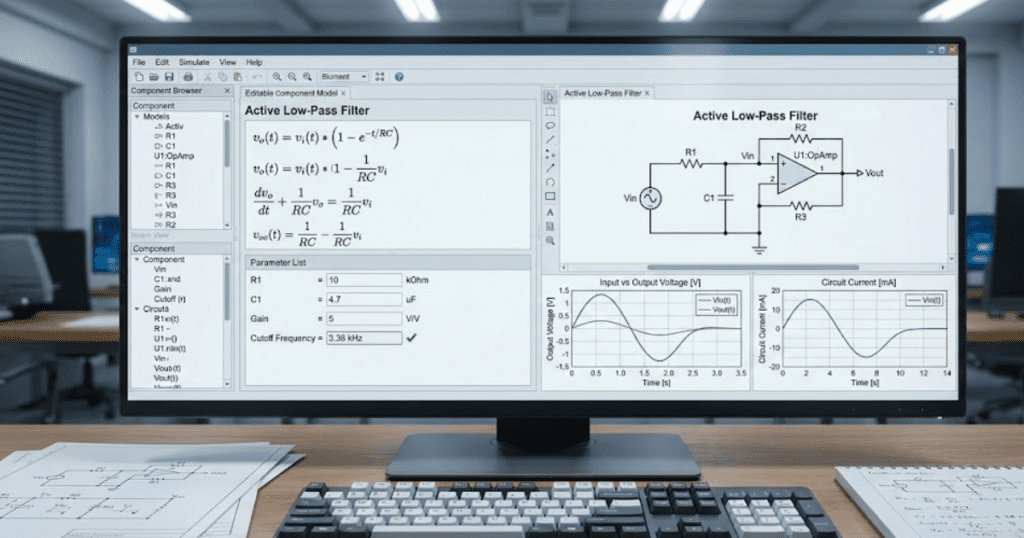

La couverture d'une bibliothèque est importante lorsqu'elle permet de réduire l'effort de modélisation sur mesure sans pour autant masquer les principes physiques derrière des blocs verrouillés. Vous recherchez des modèles de composants qui correspondent aux objectifs de votre étude, qui exposent les paramètres influant sur le comportement et qui fournissent une documentation suffisante pour vérifier les équations et les hypothèses. L'étendue d'une bibliothèque n'a d'importance que si les modèles sont cohérents et faciles à vérifier.

Les réseaux à forte densité d'onduleurs compliquent considérablement cette vérification. Selon une étude mondiale sur l'électricité, les énergies renouvelables ont représenté 30 % de la production mondiale d'électricité en 2023, ce qui signifie que de nombreuses études s'appuient désormais sur les commandes, les limites et la coordination des protections des onduleurs, et non plus uniquement sur la dynamique des machines synchrones. Si les modèles de la bibliothèque masquent la limitation de courant, le comportement des boucles à verrouillage de phase ou la saturation des commandes, vous obtiendrez des graphiques d'apparence impeccable qui ne correspondent pas au comportement réel sur le terrain.

Dans le domaine de l'enseignement, la transparence de la modélisation fait partie intégrante du programme. Les étudiants apprennent plus vite lorsqu'ils peuvent examiner une boucle de régulation, modifier la valeur d'un filtre et observer les effets de cette modification sur les formes d'onde, sans avoir à deviner le rôle d'un bloc. Dans le domaine de l'ingénierie, la transparence facilite la révision par les pairs et réduit les risques liés au transfert de tâches entre les équipes. Il convient également de vérifier comment la logique de protection et de contrôle est représentée, car le style de modélisation de l'outil déterminera la manière dont vous validerez la synchronisation, les seuils et les transitions d'état.

Évaluer les paramètres du solveur, la stabilité numérique et la reproductibilité des résultats

« La qualité d'un solveur se traduit par des exécutions stables, des diagnostics clairs et des résultats reproductibles même en cas de légères modifications des paramètres. »

Vous devriez être capable de contrôler le pas de temps ou les tolérances, de comprendre les limites de convergence et de reproduire une simulation à partir des paramètres et des versions de modèle enregistrés. Si la plateforme ne peut pas expliquer pourquoi une simulation a échoué, vous passerez plus de temps à déboguer qu'à étudier.

La stabilité numérique n'est pas seulement un « problème de solveur » ; c'est un problème lié à la discipline de modélisation pour lequel vous avez besoin d'outils d'aide. Les réseaux rigides, les boucles de contrôle serrées, les discontinuités et les commutateurs idéaux poussent tous les solveurs vers des cas limites. Les bonnes plateformes vous aident à gérer cela grâce à une gestion claire des événements, à des paramètres par défaut judicieux que vous pouvez remplacer et à des avertissements qui indiquent la cause sous-jacente. La reproductibilité inclut également les principes de base de la gouvernance : enregistrer les paramètres du solveur avec le modèle, suivre les versions des bibliothèques et conserver les métadonnées d'exécution afin que deux ingénieurs puissent confirmer qu'ils ont exécuté le même cas.

| Ce que vous testez au cours d'un essai | À quoi ressemble un bon comportement | Qu'est-ce qui ne fonctionnera pas si vous ne le faites pas ? |

| Vous exécutez deux fois le même scénario avec les mêmes paramètres. | Les résultats se situent dans les limites de tolérance indiquées et l'outil enregistre les paramètres clés. | Il est impossible de distinguer les variations liées aux outils des changements dans le comportement du système. |

| Vous modifiez le pas de temps ou les tolérances dans une plage réduite. | Les tendances restent stables et les éventuelles différences sont explicables et limitées. | Les graphiques semblent plausibles, mais reposent sur des artefacts numériques. |

| Vous testez l'initialisation à partir d'un point de fonctionnement stable. | Les transitoires au démarrage sont maîtrisés et les conditions initiales peuvent être vérifiées. | Le comportement transitoire initial fausse les résultats des systèmes de protection et de contrôle. |

| Vous provoquez un événement majeur, tel qu'un défaut ou le déclenchement d'un disjoncteur. | Le solveur signale clairement les événements et se rétablit sans instabilité silencieuse. | Les discontinuités cachées provoquent des oscillations non physiques ou une défaillance du solveur. |

| Vous consultez les rapports de diagnostic après un cycle qui a échoué ou qui a été lent. | Les messages d'erreur indiquent les éléments, les plages horaires ou les limites que vous pouvez modifier. | Le temps consacré au débogage augmente et la confiance dans le modèle diminue au sein de l'équipe. |

Évaluer les liaisons MATLAB Simulink, la collaboration et le déploiement en laboratoire

La compatibilité avec les flux de travail fait toute la différence entre un outil qui est utilisé et un outil qui reste inutilisé après son acquisition. Il convient de vérifier comment la plateforme échange des données avec MATLAB et Simulink, comment elle prend en charge les balayages de paramètres et comment elle regroupe les modèles en vue de leur partage. Le déploiement en laboratoire nécessite également des installations prévisibles, une gestion claire des licences et une cohérence des versions entre les machines.

Les contrôles d'intégration doivent porter sur les tâches que vous effectuez réellement au quotidien : importation et exportation de paramètres, exécutions automatisées et interfaces claires pour les opérations de contrôle qui s'effectuent en dehors du modèle du réseau électrique. Les contrôles de collaboration doivent quant à eux se concentrer sur la révision du modèle et le suivi des modifications, car la crédibilité de la simulation repose sur la capacité à expliquer ce qui a changé et pourquoi les résultats ont évolué. Les laboratoires d'enseignement ajoutent une contrainte supplémentaire : les étudiants doivent pouvoir se mettre rapidement au travail avec un minimum de divergences de configuration entre les postes de travail, sans quoi le cours se transforme en exercice informatique.

SPS SOFTWARE est souvent évalué à cette étape, car les équipes recherchent des modèles de composants ouverts et modifiables, associés à un flux de travail adapté à la conception de systèmes de contrôle basés sur MATLAB et Simulink. Cette combinaison pratique est essentielle lorsque l'on a besoin à la fois de transparence pour l'apprentissage et d'une exécution cohérente pour les études d'ingénierie. Les essais de l'outil devraient inclure un bref « test de transfert » au cours duquel une personne crée un cas et une autre le réexécute à partir de zéro en utilisant uniquement le package partagé, car cela permet de mettre en évidence très tôt les dépendances cachées.

Élaborer une grille d'évaluation pour comparer des outils de simulation électrique

Une grille d'évaluation permet de faire du choix des outils une décision reproductible que vous pouvez justifier auprès d'un responsable de laboratoire ou d'un directeur technique. Commencez par définir quelques critères incontournables liés aux objectifs de votre étude, puis attribuez des notes aux autres critères en fonction de la fréquence à laquelle vous utiliserez chaque fonctionnalité. Une bonne grille d'évaluation vous oblige également à documenter les compromis plutôt que de débattre de vos préférences.

Veillez à ce que la grille d'évaluation soit suffisamment concise pour que vous puissiez réellement l'utiliser dès la première réunion. Ces cinq catégories couvrent l'essentiel du travail de sélection sans pour autant négliger les détails techniques :

- Évaluer l'adéquation de la fidélité de l'étude en fonction des besoins de l'EMT ou du RMS

- Modéliser la transparence et rendre les équations et les paramètres vérifiables

- Une couverture de bibliothèque adaptée à votre réseau et à votre périmètre de contrôle

- Robustesse numérique et reproductibilité entre les exécutions

- Des processus de travail et des déploiements adaptés aux laboratoires et aux équipes

Le jugement repose sur la manière dont les résultats se comportent sous pression, et non sur une feuille de calcul parfaite. Si un outil ne s'impose que lorsque vous accordez une importance excessive à des fonctionnalités secondaires, il vous fera défaut plus tard, lorsque les délais se resserreront et que vous aurez besoin d'exécutions fiables. Lorsque vous appliquez cette grille d'évaluation de manière cohérente, SPS SOFTWARE a tendance à démontrer sa valeur là où la transparence de la modélisation et la reproductibilité de l'exécution sont les plus importantes, c'est-à-dire dans le domaine du choix d'outils qui détermine la confiance à long terme dans les résultats. L'objectif n'est pas un outil doté de la liste de fonctionnalités la plus longue, mais un outil que vous pouvez expliquer, réexécuter et défendre.